Los algoritmos nos hacen vivir en bucles del pasado

19 abril, 2017

Vivimos a través de algoritmos que median cada vez más en lo que hacemos. Quizás no seamos conscientes, pero a menudo guían muchas de las acciones cotidianas que realizamos: dónde nos alojaremos en el próximo viaje, dónde comeremos el viernes, cuál es la mejor ruta para ir al cine… Su papel no se queda únicamente en pequeñas decisiones rutinarias sino que está llegando a ámbitos como el de la medicina. Hablemos claro: cada vez se aplican a más sectores y están más presentes en nuestra vida. Sino, hazte la siguiente pregunta: ¿has pensado cuántas decisiones, en las que haya mediado la tecnología, has tomado tú de manera individual? Sea cual sea tu respuesta ¿estás segura de que no fue un algoritmo el que eligió por ti?

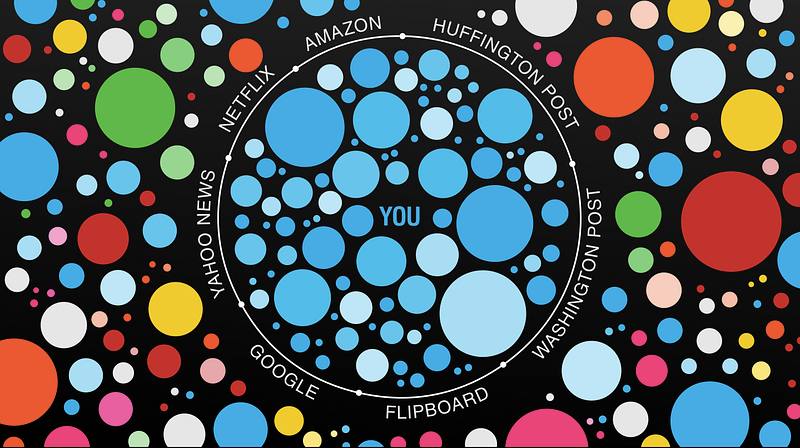

La burbuja de filtros: el internet que tú ves es muy diferente al mío

La web personalizada aprende de nuestras interacciones. Google abandera esta personificación en su buscador, y le sirve para decidir por nosotros lo que nos interesará en el futuro en base a elecciones que hicimos en el pasado. Esto quiere decir que cada vez que hagamos una búsqueda, será menos probable por ejemplo, que encontremos información que ponga en duda o simplemente amplíe nuestra visión del mundo.

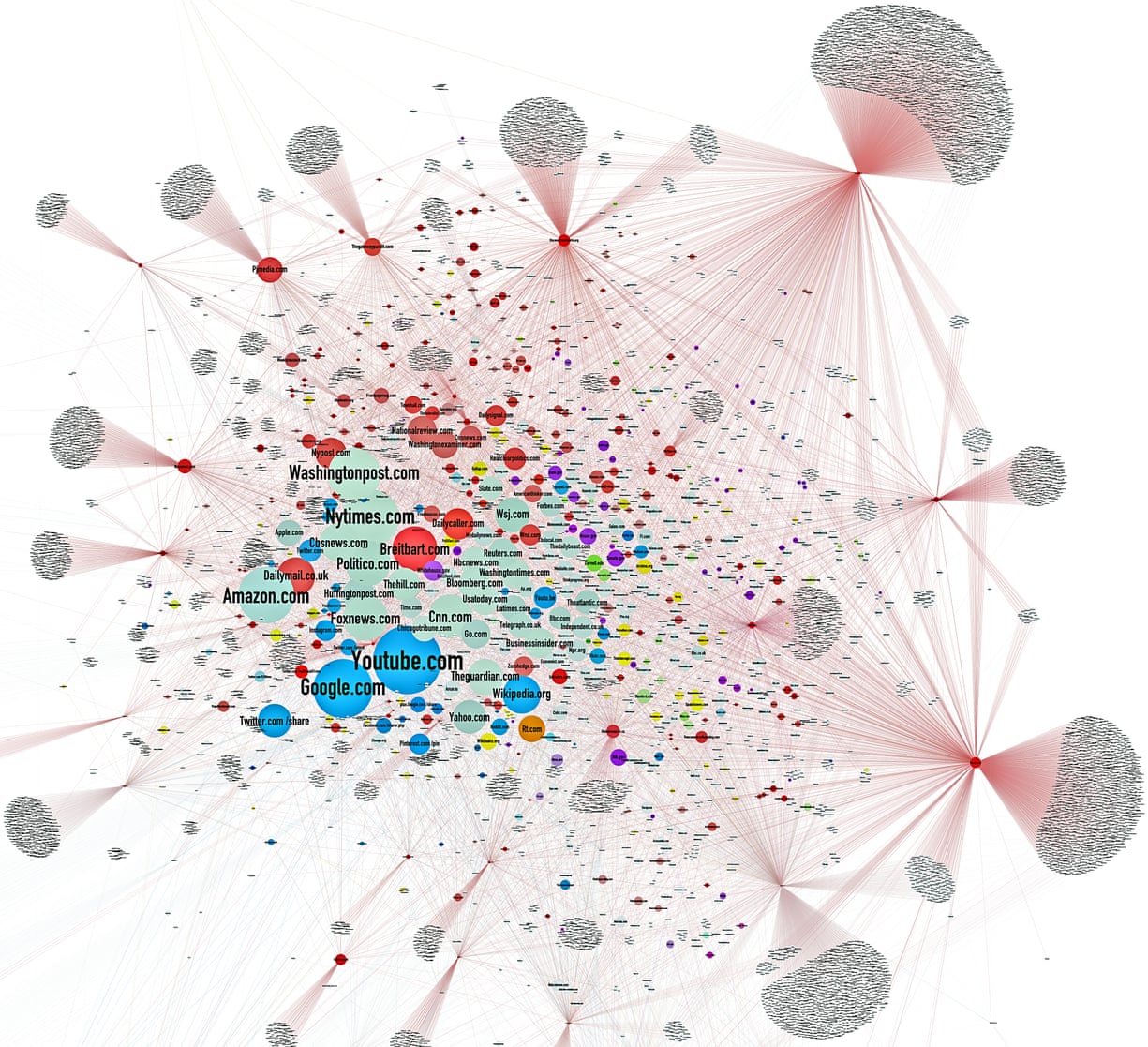

La consecuencia es que se genera una especie de mundo en el que acabamos encerrados por el algoritmo de Google. El activista Eli Pariser habla del fenómeno y llegó a nombrarlo como “burbuja de filtros”: un universo personalizado para cada uno de nosotros en el que solo se nos muestra lo que queremos ver, o más bien, lo que el algoritmo piensa que nos interesa. O sea que esa burbuja es creada para cada uno de nosotros, por lo que son diferentes entre sí. Pariser habla de ello en su famoso TED, y asegura que si dos personas introducen los mismos términos de búsquedas en el buscador, los resultados no serán los mismos. Y eso quiere decir que búsqueda tras búsqueda verás reforzada tu opinión o tu ideología, creando grandes cercos informativos y de alguna manera, configurando la realidad que cada uno percibimos a través de este brutal filtrado.

Pensamos que con Internet tenemos acceso a todo y a todo tipo de información; creemos que lo único que nos separa de todo ello es un simple clic. Pero vemos que no hay nada más lejos de la realidad: los algoritmos que controlan las plataformas han estado, y continúan, aprendiendo de nosotros para mostrarnos, sin que nadie nos consulte, lo que creen que puede ser de nuestro interés. Y por supuesto, nos ocultan todo aquello que consideran que esta fuera de él. Así se alimenta la burbuja de filtros; en nuestras búsquedas quedan muchas cosas fuera y al final, lo que se nos esconde son perspectivas y visiones del mundo, lo que nos imposibilita ampliar nuestros horizontes. La información que se nos presenta favorece que mantengamos y reforcemos posiciones inmovilistas.

De todo esto hablaba Eli Pariser en 2011, y advertía sobre los peligros de las burbujas de filtros. Seis años después, fuera de todo pronóstico, teníamos el Brexit, y más tarde, la victoria de Donald Trump en Estados Unidos. En un artículo en el períodico The Guardian, decían lo siguiente:

«Como resultado de la votación de Reino Unido para abandonar la UE y la victoria de Donald Trump en las elecciones estadounidenses, muchos de los que esperaban que los resultados fueran a la inversa quedaron conmocionados. ¿Cómo podía suceder esto cuando casi todos los que conocían habían apoyado al otro lado?»

¿Qué parte del mundo se nos ha pasado para no darnos cuenta de esta tendencia social? La burbuja de filtros fomenta la fragmentación, y con ella, llega la polarización de la población. Consigue que una parte de la sociedad se oculte para la otra. Búsqueda tras búsqueda, más habitantes y más posturas van desapareciendo, para finalmente, quedarnos cada vez más solos en el eco de intereses y búsquedas pasadas. Pariser comentaba en ese mismo artículo del medio británico que «si solo ves publicaciones de gente que es como tú, te sorprenderás cuando alguien muy distinto a ti gane la presidencia». Y continuaba: «el peligro de estos filtros es que crees que estás obteniendo una visión representativa del mundo, y realmente no es así, y no lo sabes».

La burbuja de filtros y las fake news

Como ya hemos dicho, los algoritmos se emplean cada vez en más ámbitos, por lo que mucho menos el caso de Google es aislado. Todas las redes sociales los usan, entre otras muchas plataformas. Uno de los ejemplos más significativos de este tipo de tecnología es Facebook. Hasta 2011 su algoritmo se conocía como Edgerank, y aunque es cierto que en el sector del marketing digital muchos siguen llamándolo así, actualmente el algoritmo ha alcanzado una complejidad mucho mayor basada en el aprendizaje automático.

Cada cierto tiempo, la red social va introduciendo cambios en su tecnología, lo que hace que los que se dedican a los medios sociales se vuelvan locos con cada una de las actualizaciones. Este algoritmo tiene una importancia cada vez mayor: es el único encargado de decidir qué noticias nos son mostradas en nuestro feed o muro. Suele basarse en nuestras interacciones: con qué tipo de contenidos realizamos más acciones, de qué usuarios, la afinidad que tenemos con ellos, etc. El resultado final es que tendrás tendencia a ver las noticias más populares entre las personas que comparten tus creencias políticas.

Uno de los problemas que presenta esta tecnología del gigante social es la poca transparencia que existe respecto a su algoritmo. Algo bastante grave cuando dependemos de él a la hora de informarnos; los contenidos que consumimos vienen cada vez más de esta red, incluidas las noticias. Las ocasiones en las que nos dirigimos a la web de un medio disminuyen cada vez más. En cambio, tendemos a centralizar todos los inputs en su solo lugar, y este suele ser Facebook.

Así que Facebook, decide la información y las noticias que leemos. Esto está causando bastante polémica en los medios de comunicación y en el periodismo en general. El principal motivo es que Facebook está ejerciendo de editor decidiendo qué noticias son o no relevantes para la audiencia y en definitiva, qué debe o no mostrarse. Es difícil no recordar el ejemplo de censura de la icónica foto de guerra de la niña desnuda huyendo de un ataque con napalm, una imagen que además fue ganadora del premio Pulitzer. El medio que publicó esa foto y sufrió su retirada de la red social fue el noruego Afterposten.

Tras el episodio, su editor jefe, Espen Egil Hansen, le escribió una carta abierta a Mark Zuckerberg haciendo un llamamiento para obtener una mayor transparencia y responsabilidad por parte de su red. El fin de su petición no era más que lograr entender su contexto y qué es lo que ocurre realmente en ella: «Eres el editor más poderoso del mundo», escribió Hansen.

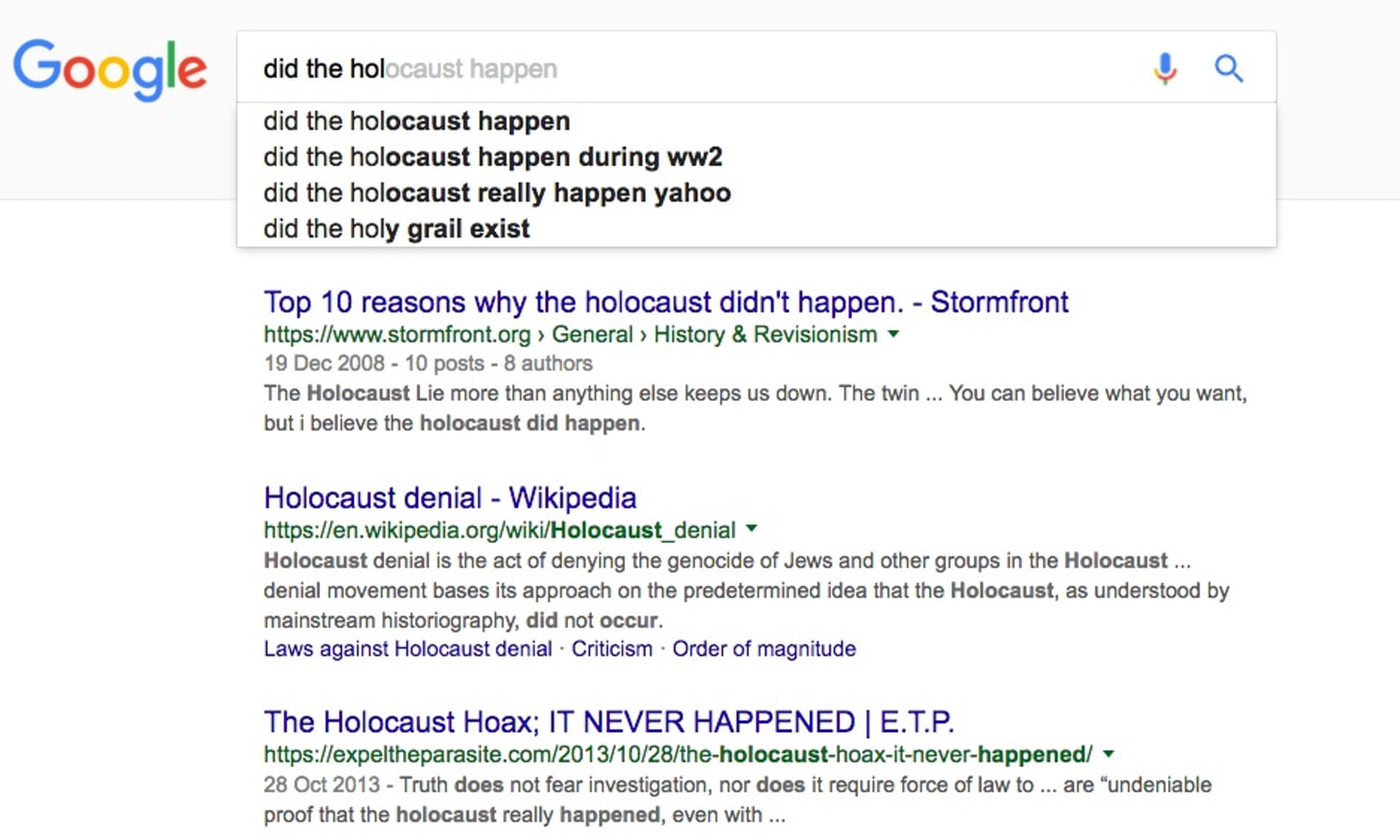

Google también ha sufrido presión como consecuencia de esa responsabilidad que tienen estas grandes empresas en la construcción de la realidad. Su caso en concreto fue por negarse a editar manualmente sus resultados de búsqueda para eliminar las consecuencias imprevistas de sus ‘algoritmos de autocompletar’.

Íntimamente relacionado con todo esto están las fake news. No es que los algoritmos las generen, pero sí es cierto que la burbuja de filtros crea el ecosistema perfecto para su desarrollo. Este tipo de contenido vió la luz por primera vez durante la carrera presidencial estadounidense de Trump contra Clinton. A lo largo de la campaña se crearon una gran cantidad de artículos que aprovecharon los prejuicios pro Trump y pro Clinton para inventar historias que los usuarios leerían.

Otro punto a tener en cuenta en este aspecto es que cada vez se publican más contenidos fuera de las webs, o lo que es lo mismo, se publica de manera nativa en redes. El caso del vídeo fue bastante significativo el año pasado, cuando Facebook comenzó a potenciar este tipo de contenidos frente al resto. Se vivió una migración de Youtube a Facebook como plataforma en la publicar nativamente estos formatos. Dentro de esa gran apuesta, la red pagó a algunos medios de comunicación para que publicasen contenidos de este tipo en ella. Por otro lado, el mismo medio social también lanzó los Instant Articles, permitiendo a los medios pudiesen publicar textos directamente en él sin necesidad de apoyo en sus webs.

/cdn0.vox-cdn.com/uploads/chorus_asset/file/7231547/Screen%20Shot%202016-10-06%20at%201.01.03%20PM.png)

Tras todas las actualizaciones de Facebook, y de otras plataformas, hay un afán en aumento de que permanezcamos el mayor tiempo posible en ellas. Un interés aún casi que más fuerte si se trata de una app. De ahí que los contenidos se internalicen y se publiquen de manera nativa en las redes y que cada vez haga menos falta salir de las aplicaciones para consultar contenidos externamente. En definitiva, cada vez se piensa y desarrolla más Internet y la web para ser usada desde el móvil. Y esto acarrea una serie de consecuencias. Hagamos un pequeño recorrido:

- La web se está contrayendo. De esto habla Marga Padilla. Yo tuve la ocasión de escucharla en el Congreso Move.net (2015 Sevilla). Aquí hay una transcripción que realicé de su charla gracias al audio que me proporcionó el Congreso. Básicamente lo que ella plantea es que antes teníamos acceso a toda la web a través de la navegación por URL. Ahora tendemos a navegar cada vez más desde el móvil y lo hacemos desde las app. Estas son trozos de la web y de Internet creadas por empresas y que nos las dan ‘gratuitamente’ (porque en realizada a cambio les damos nuestros datos). Y a través de ellas, accedemos a la web que ellos quieren. De la mayoría de contenidos que visitamos no podemos obtener una dirección o URL, así que solo es posible acceder a ellas mediante la aplicación y no son contenidos enlazables, que era la novedad y el gran avance de Internet.

- Se crean guetos digitales, algo íntimamente ligado a las burbujas de filtros. O quizás es otra forma diferente de llamar al mismo efecto. En esta entrevista, Natalie Fenton asegura que «Internet crea guetos políticos de los que ya están bien informados; afianza las desigualdades que existen offline».

- La competitividad por salir en los rankings de Google (o por tener más impresiones en Facebook, etc). Ya no se piensa en aportar conocimiento al común o aportar a la web, sino en atraer a todo el mundo hacia nuestro sitio. Así que ya no colaboramos sino que la mayoría de las veces, competimos.

Hiper personificación de la experiencia

El auge de los algoritmos obedece a una tendencia cada vez mayor de personificación de la experiencia de compra y de consumo. Actualmente hay tantos datos de los usuarios disponibles que es posible entrenar a los algoritmos para conseguir una gran precisión. Es lo que se conoce como big data. El término para quien no lo conozca, hace referencia a la estela de datos masivos que vamos dejado tras nosotras. Su procesamiento es tremendamente útil para el caso del que hablamos, pero también les permite a las empresas conocer como nunca a antes a sus usuarios.

Y con los smartphones, abrimos una gran puerta de acceso a nuestra privacidad. Además de toda la información que obtienen las plataformas de nosotros, Facebook por ejemplo usa nuestra agenda de contactos y basa en ella nuestras futuras amistades. De momento no utiliza nuestra ubicación, ni tampoco mensajes y llamadas. Aunque en teoría podría desde un teléfono Android, ya que Google permite compartir este tipo de información.

Los teléfonos inteligentes son una especie de dispositivos de registro y seguimiento que llevamos libremente. No solo saben a dónde vamos, sino para qué utilizamos una app cuándo, qué edad tenemos, qué sexo, con qué tipo de contenidos permanecemos más tiempo en ella… Multitud de datos que vamos dejando y con los que a las empresas se les hace la boca agua. Con ellos pueden personalizar aún más las experiencias de compra, por supuesto, sus productos. Como se ha dicho más arriba, navegamos cada vez más a través de las aplicaciones, así que es más fácil hacerse con datos de las audiencias, a las que cada vez se fragmenta más para dar unos servicios cada vez más personalizados.

Después de todo esto, la pregunta lógica que se nos puede venir a la cabeza es: ¿cómo salimos de este círculo vicioso? Bueno, pinchar la burbuja de filtros no es sencillo. Puedes tratar de controlar aquello sobre lo que haces clic o lo que buscas por redes sociales, pero a la larga censurarse, que es en lo que se traduce esto, es absurdo. Sin embargo, puedes seguir una serie de consejos para salir de ella (aquí algunos más detallados pero en inglés), y aún así sigue siendo una tarea ardua. ¿A qué partes del mundo hemos dejado de tener acceso? ¿y qué nos estaremos perdiendo por no poder salir de los bucles del pasado?